Los entornos de trabajo son cada vez más virtuales, con empleados de cualquier parte del mundo colaborando en un mismo proyecto. Lo mismo sucede en las relaciones personales, donde la variedad cada vez mayor de redes sociales ha abierto la posibilidad de compartir aficiones, intereses o debates con personas de casi cualquier rincón del planeta. Personas con las que interactuamos, en la mayoría de los casos, únicamente a través de la red de redes.

En situaciones como ésta, lo único que podemos hacer es tratar de entender sus patrones de comunicación para entender su comportamiento informacional. Sin embargo, esos patrones pueden variar, al igual que su conducta, pasando desapercibido. Shuyuan María Ho, profesora asistente en la Facultad de Comunicación e Información de la Universidad Estatal de Florida, en Estados Unidos, y experta en seguridad cibernética, ha creado un software capaz de valorar el carácter de una persona e identificar posibles conductas peligrosas.

Su trabajo ha sido recompensado recientemente con una beca de la Fundación Nacional de Ciencia (NSF) estadounidense para poner a prueba las posibilidades de comercialización del producto en los próximos seis meses. En un comunicado de la Universidad, la profesora explica que están investigando la viabilidad comercial de una tecnología que actúa como un detector de confianza basándose en el análisis de comunicaciones online.

Y es que son muchas las corporaciones, organizaciones gubernamentales, e incluso gente particular, que se comunica diariamente en el ciberespacio. Muchos de ellos sin haber tenido nunca una reunión cara a cara o incluso a través del teléfono. «A veces los conoces, otras no», subraya Ho. Por tanto, si nunca ha existido un contacto personal, la única prueba sobre la que se basa la confianza depositada es la comunicación online.

Aprendizaje automático

A través de una investigación anterior sufragada también por la NSF, Ho y un equipo de investigación de la Universidad de Cornell simularon un entorno de juegos online para representar diferentes tipos de amenazas, como el fraude, el engaño y la traición. «Este tipo de comportamiento es bastante predecible en base a las señales del lenguaje que somos capaces de identificar», subraya Ho.

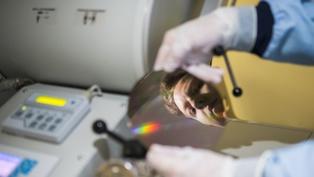

Con esos resultados, la investigadora ha desarrollado una aplicación de software que analiza la comunicación humana en base a conversaciones y comportamientos online que pueden delatar la intención de una persona. «Esta aplicación se puede entender como una herramienta de inteligencia artificial para detectar cambios en la motivación y la confianza de los usuarios», advierte Ho.

Mediante diferentes mecanismos, el sistema crea un perfil de usuario estadístico y aprende sobre sus patrones de comportamiento informacional, basándose para ello en el lenguaje y el diálogo con otros usuarios en su interacción en medios sociales.

La aplicación podría ser útil para fuerzas de seguridad, militares, agencias de defensa y organismos gubernamentales, así como para grandes corporaciones como Microsoft o Google, con el fin de mantener a buen recaudo sus secretos comerciales o la propiedad intelectual.

El nivel de confianza de una persona puede cambiar, por lo que se trata de una relación muy dinámica. «No es como una autorización en la que se verifican los antecedentes de alguien y esa persona se queda en la misma posición durante 10 ó 20 años sin ningún cambio”, advierte Ho. El nivel de confiabilidad de una persona puede cambiar y variar considerablemente, por lo que es más importante realizar un seguimiento y detectar si es una persona estable incluso antes que ponerle cara.

Hacer un comentario