Determinar la exactitud de los resultados que obtiene una red neuronal ha dejado de ser un problema de laboratorio: en la actualidad, estos sistemas pueden estar implicados en la conducción de un vehículo autónomo o en un diagnóstico médico. En consecuencia, tienen impacto en la realidad concreta y pueden salvar vidas. Ahora, una investigación realizada por científicos del Instituto Tecnológico de Massachusetts (MIT) y la Universidad de Harvard crea un sistema capaz de estimar rápidamente la confianza que podemos tener en las redes neuronales y sus resultados.

Cuando un vehículo autónomo se acerca a la intersección de dos calles, es una red neuronal de aprendizaje profundo la que indicará si todo está en condiciones para girar o si, por el contrario, debemos estar atentos a cualquier tipo de obstáculo o complicación. En otras palabras, confiamos en la exactitud de la información que nos entregan estos sistemas de Inteligencia Artificial. Pero debemos saber que también se equivocan: ¿hasta dónde podemos confiar a ciegas en ellos?

Según una nota de prensa, los especialistas explican que las respuestas y los datos que nos brindan las redes neuronales para poder tomar decisiones son confiables en un 99%. El 1% restante es el objetivo del trabajo de los científicos que llevaron adelante esta investigación, logrando diseñar un sistema que determina el grado de fiabilidad de las redes y puede identificar con máxima rapidez las equivocaciones que se están cometiendo, ya sea por datos erróneos o faltantes.

Frente a decisiones que deben tomarse en cuestión de segundos, los esquemas actuales de estimación de la incertidumbre en redes neuronales resultan muy lentos y, además, extremadamente onerosos. El nuevo sistema no solamente incrementa la exactitud y la precisión en la determinación de errores, sino que además aumenta considerablemente la velocidad de respuesta y reduce el gasto. En consecuencia, se transforma en una alternativa más eficiente y segura en un área crítica.

Decisiones trascendentales

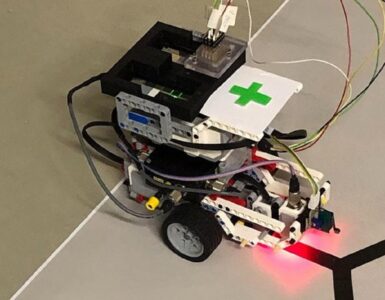

Alexander Amini, estudiante de doctorado en el MIT y autor principal del estudio, sostuvo que “no solamente es importante incrementar la capacidad de estos modelos de alto rendimiento, sino también comprender cuándo no podemos confiar en ellos”, indicó. Y las causas son fáciles de entender, considerando que permanentemente se incrementa el uso de redes neuronales de aprendizaje profundo en campos como la salud, la seguridad o el transporte, en los cuales un error puede significar la pérdida de vidas humanas.

La principal virtud del nuevo esquema y su ventaja comparativa con respecto a los modelos actuales es que logra captar en tiempo real la evidencia que apoya cada decisión tomada por el sistema. De esta forma, puede determinar el grado de confianza que merece la predicción realizada y, al mismo tiempo, si la incertidumbre se puede reducir ajustando la red neuronal o eliminando errores en los datos sobre los cuales ha trabajado el modelo.

En una prueba realizada en torno a un problema de visión por ordenador, la red neuronal creada por los investigadores pudo determinar con eficacia la distancia exacta entre una cámara y cada píxel de una imagen estudiada. Pero la diferencia con otros sistemas fue que también pudo indicar con precisión las ubicaciones o sectores en los cuales los datos no eran fiables.

“Si se tratara de una aplicación de atención médica, tal vez no confiaríamos en el diagnóstico que nos está dando el modelo y, en cambio, buscaríamos una segunda opinión», expresó Amini. Queda claro con este ejemplo la gran importancia que supone avanzar en la determinación de la confianza que se puede tener en las redes neuronales de aprendizaje profundo, como así también en la identificación de los errores que pueden cometer estos sistemas.

Referencia

Deep Evidential Regression. Alexander Amini, Wilko Schwarting, Ava Soleimany and Daniela Rus. arXiv (2019).

Foto: Alina Grubnyak en Unsplash.

Hacer un comentario