Un equipo de científicos del proyecto Decisions in motion del Sexto Programa Marco de la Unión Europea ha conseguido desarrollar un robot que posee un sistema de visión que imita las funciones visuales clave del cerebro humano.

En un futuro, este sistema podría servir para crear robots capaces de maniobrar rápida y certeramente a través de entornos llenos de objetos o para desarrollar dispositivos que guíen a personas ciegas, entre otras aplicaciones.

Según publica ICT Results, el sistema visual humano resulta extremadamente difícil de imitar para los especialistas en informática. De hecho, el análisis de los datos visuales, a menudo ambiguos, para la detección de objetos y el registro de sus movimientos, ha supuesto desde siempre un verdadero desafío para la inteligencia artificial.

Imitando a la Naturaleza

Hace tres años, los investigadores de Decisions in Motion decidieron observar a la Naturaleza para encontrar soluciones a este desafío.

La colaboración entre neurocientíficos y especialistas en cognición permitió a partir de entonces estudiar cómo funcionan los sistemas visuales de los mamíferos avanzados, de los primates y de las personas.

Al mismo tiempo, científicos computacionales y especialistas en robótica incorporaron sus conocimientos sobre redes neuronales y robots móviles.

El resultado ha sido la fabricación de un robot que puede atravesar una habitación repleta guiado sólo por lo que “ve”.

En qué consiste

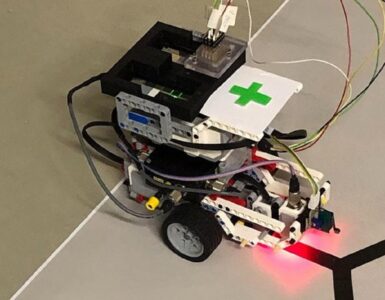

Según publica la revista Technology Review, del MIT, el robot desarrollado por Decisions in Motion consiste en una plataforma con ruedas y una “cabeza” robótica a la que se han incorporado dos cámaras para la captura de imágenes.

El robot es capaz de girar la cabeza y de mirar hacia arriba y hacia abajo, o a los lados, para hacerse una idea de su entorno. Acto seguido, calcula rápidamente su propia velocidad en relación a su entorno.

La máquina está controlada por unos algoritmos diseñados para simular las distintas partes del sistema visual humano. Así, en lugar de capturar y trazar un mapa de su entorno una y otra vez para planificar su ruta –que es lo que hace la mayoría de los robots-, la máquina europea utiliza una red neuronal simulada que actualiza su posición en relación al entorno, realizando constantes ajustes con cada nueva información. Esto es una imitación del proceso visual y planificación de movimiento humanos.

Estudiar el cerebro humano

En declaraciones para ITC Results, Mark Greenlee, director del proyecto, señala que “hasta ahora, los algoritmos que se han utilizado son muy lentos y sus decisiones no son aún lo suficientemente fiables como para ser útiles”.

Sin embargo, permitirán generar nuevos algoritmos que tomarán todas estas decisiones en tan sólo unos milisegundos, y utilizando un hardware convencional.

Los investigadores de Decisions in Motion usaron una amplia diversidad de técnicas para comprender mejor cómo el cerebro humano procesa la información visual, especialmente la información sobre el movimiento.

Por ejemplo, registraron la activación de neuronas individuales y grupos de neuronas como respuesta a señales de movimiento. Asimismo, utilizaron la técnica de captación de imágenes mediante exploración magnética funcional (fMRI) para rastrear momento a momento las interacciones entre diferentes regiones del cerebro a medida que los voluntarios realizaban tareas visuales. Por último, fueron realizados estudios neuropsicológicos de personas con problemas de procesamiento visual.

Los investigadores esperaban comprender mejor cómo el sistema visual capta el entorno, detecta objetos, discierne movimientos, distingue entre el movimiento independiente de los objetos y los movimientos de su propio organismo, y planea y controla el movimiento hacia un objetivo.

Red neuronal artificial

Tras obtener una comprensión de cómo gestiona el cerebro humano la visión y el movimiento de los objetos visualizados, los científicos crearon una red neuronal artificial con tres niveles que imitan los subsistemas visuales reales del nivel primario, medio y más alto.

Asimismo, también utilizaron lo que habían aprendido sobre el flujo de información entre las regiones cerebrales orgánicas analizadas, para controlar el flujo de información del interior del “cerebro robótico”.

Según Greenlee, el resultado es básicamente una red neuronal con ciertas características biológicas que permite que el robot imite una serie de funciones del cerebro humano, como el reconocimiento de objetos, la estimación del movimiento o la toma de decisiones, y consiga recorrer una habitación yendo hacia objetivos concretos a la vez que evita los obstáculos y las paredes.

Con estas funciones, el robot de Decisions in Motion no se mueve como otros robots más rápidos y eficientes, pero sí ha permitido comprender mejor cómo se desenvuelven los humanos, adaptando su trayectoria en función de la velocidad al caminar, por ejemplo.

Posibles aplicaciones

Según Technology Review, esta comprensión podría dar lugar a aplicaciones como la de la creación de sillas de ruedas “inteligentes”, capaces de circular con soltura en espacios interiores.

Unos cuantos miembros del consorcio de Decisions in Motion han solicitado una subvención para seguir investigando esta aplicación, mientras que otro de los socios originales, Cambridge Research Systems, del Reino Unido, está desarrollando un dispositivo que se coloca en la cabeza y que podría ayudar a las personas con discapacidad visual a detectar obstáculos y peligros, comunicándoselos a la persona que lleve puesto el aparato.

La versión comercial de este dispositivo ha sido bautizada como VisGuide. Por último, los descubrimientos realizados podrían impulsar la creación de máquinas capaces de moverse en espacios abarrotados.

Hacer un comentario