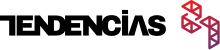

Investigadores de la Universidad de Helsinki (Finlandia) han conseguido que un ordenador perciba, interprete y refleje en imágenes y en tiempo real lo que una persona tiene en su mente.

Se trata de una nueva generación de los interfaces cerebro-ordenador, una tecnología basada en la captación de ondas cerebrales que un ordenador interpreta y traduce en señales operativas: por ejemplo, personas con discapacidad pueden rehabilitar una función motora.

Estos interfaces han desarrollado con éxito una comunicación de una sola dirección entre un cerebro y un ordenador para suplir una discapacidad, entre otras aplicaciones posibles.

Leyendo la mente

El nuevo interfaz, capaz de “leer” la mente humana, se apoya en la inteligencia artificial para potenciar la relación cerebro-ordenador: modela simultáneamente las señales neuronales con su representación en la pantalla de un dispositivo.

Eso significa que podemos ver en una pantalla de ordenador lo que una persona está imaginando, al mismo tiempo que ella lo percibe en su pensamiento.

La imagen digitalizada de la imaginación humana tiene una resolución insólita porque el nuevo interfaz aplica una rama de la inteligencia artificial, conocida como red generativa antagónica (GANs por sus siglas en inglés).

Esta red generativa es una forma avanzada de aprendizaje profundo que genera imágenes casi idénticas a las reales: lo consigue gracias a la experiencia adquirida por sus algoritmos en el procesamiento de la información.

Viendo caras

Esta tecnología, cuyos resultados se publican en Scientific Reports, fue aplicada experimentalmente con un total de 31 voluntarios.

A todos los participantes se les mostraron cientos de imágenes generadas por IA de personas de apariencia diversa: unas eran jóvenes o mayores, otras morenas o rubias, unas sonreían y otras no.

Mientras contemplaban esa sucesión de imágenes digitales aleatorias, la red neuronal registró mediante encefalografía (EEG) la actividad bioeléctrica de sus cerebros y los patrones correspondientes a las características de cada cara.

Luego se pidió a los voluntarios que se concentraran en aquellas caras que tenían unas características especiales: unos voluntarios en las que sonreían, otros en las que parecían envejecidas.

De esta forma, la red neuronal identificó los parámetros preferidos de las caras (diagramas eléctricos) por cada persona del experimento.

Conociendo esa preferencia cerebral individualizada por determinado tipo de caras, la red neuronal fue capaz de determinar a continuación en qué caras estaban pensando cada uno de los voluntarios.

Y reflejó en una pantalla la imagen virtual de una cara nueva, completamente diseñada por la red neuronal, que se ajustaba fielmente, según los investigadores, a la imagen que estaba pensando cada uno de los voluntarios. La precisión obtenida fue del 83%.

Imágenes nuevas, aplicaciones nuevas

Tuukka Ruotsalo, uno de los investigadores, explica así, en un comunicado, el significado del experimento: “La técnica combina respuestas humanas naturales con la capacidad del ordenador para crear nueva información. En el experimento, solo se pidió a los participantes que miraran las imágenes generadas por ordenador. La computadora, a su vez, modeló las imágenes mostradas y la reacción humana hacia las imágenes utilizando respuestas del cerebro humano. A partir de esto, la computadora pudo crear una imagen completamente nueva que coincide con la intención del usuario”.

Michiel Spapé, investigador principal, añade: “esta técnica no reconoce los pensamientos, sino que responde a las asociaciones que tenemos con las categorías mentales. Por lo tanto, si bien no podemos averiguar la identidad de una «persona mayor» específica en la que estaba pensando un participante, podemos comprender lo que asocian con la vejez. Por lo tanto, creemos que puede proporcionar una nueva forma de obtener información sobre los procesos sociales, cognitivos y emocionales”.

Según los investigadores, aunque esta tecnología solo puede discernir conceptos amplios en los pensamientos de una persona, como la edad, el color o si una persona está sonriendo, demuestra que un ordenador puede ser entrenado para leer pensamientos subjetivos basados en un EEG.

En el futuro podrá ayudar a las personas a dibujar algo que no pueden imaginar, y también a comprender mejor la percepción y los procesos subyacentes del cerebro humano.

Referencia

Neuroadaptive modelling for generating images matching perceptual categories. Lauri Kangassalo, Michiel Spapé & Tuukka Ruotsalo. Scientific Reports volume 10, Article number: 14719 (2020). DOI:https://doi.org/10.1038/s41598-020-71287-1

Nuevas herramientas, para superar las limitaciones físicas de paraplejicos, hemiplejicos, y cuadraplejicos, y mejorar su calidad de vida.

Esperemos que se llegue a profundizar en la técnica, hssta hacerla igual a a una persona no limitada.

Por supuesto, también hay que limitar por la vía legal, el abuso de dicha tecnología, sobre los derechos individuales, y su privacidad.